El riesgo oculto de depender demasiado de la IA: científicos alertan sobre efectos en la memoria y el pensamiento

La rápida expansión de herramientas de inteligencia artificial como ChatGPT, Google Gemini y Claude está transformando la forma en que las personas estudian, trabajan y producen información. Sin embargo, junto con sus ventajas, comienza a crecer una preocupación entre investigadores y neurocientíficos: el posible impacto que esta dependencia tecnológica podría tener sobre la memoria, el pensamiento crítico y la salud cognitiva a largo plazo.

La inquietud surge especialmente en torno a los grandes modelos de lenguaje (LLM, por sus siglas en inglés), sistemas capaces de redactar textos, resolver preguntas complejas, generar ideas e incluso realizar tareas que antes requerían esfuerzo intelectual humano. Para algunos expertos, el problema aparece cuando las personas dejan de usar estas herramientas como apoyo y comienzan a delegar en ellas buena parte de sus procesos mentales.

Una de las investigadoras que estudia este fenómeno es Nataliya Kosmyna, especialista en interacción entre humanos y computadoras del Massachusetts Institute of Technology. Su interés comenzó al notar cambios llamativos tanto en estudiantes como en postulantes académicos.

Kosmyna observó que muchas cartas de presentación de aspirantes a pasantías tenían un estilo sospechosamente similar: textos extensos, perfectamente redactados y con conexiones abstractas que parecían generadas por inteligencia artificial. Paralelamente, comenzó a detectar que algunos estudiantes parecían olvidar contenidos con más facilidad que años atrás.

Esto la llevó a investigar cómo el uso constante de herramientas de IA podría estar modificando la actividad cerebral y la manera en que las personas procesan la información.

Junto a colegas del MIT Media Lab, Kosmyna realizó un experimento con 54 estudiantes universitarios divididos en tres grupos. El primero debía escribir ensayos utilizando ChatGPT, el segundo podía apoyarse en el buscador de Google —sin respuestas generadas por IA— y el tercero debía trabajar únicamente con sus propios conocimientos, sin apoyo tecnológico.

Mientras redactaban los ensayos, los investigadores midieron la actividad cerebral de los participantes. Los resultados preliminares mostraron diferencias importantes.

Según Kosmyna, quienes trabajaron únicamente con su mente mostraron una intensa activación cerebral distribuida en múltiples regiones asociadas con creatividad, memoria y procesamiento de información. El grupo que utilizó Google presentó una fuerte actividad en áreas visuales relacionadas con la búsqueda y análisis de información.

En contraste, el grupo que empleó ChatGPT registró una actividad cerebral considerablemente menor. La reducción alcanzó hasta un 55 % en algunas mediciones. La investigadora explicó que el cerebro no “se apagó”, pero sí mostró menor participación en áreas vinculadas con el pensamiento creativo y el procesamiento profundo.

Otro hallazgo preocupante fue que varios estudiantes que utilizaron IA no lograban recordar fragmentos de sus propios textos después de entregarlos. Algunos incluso afirmaron no sentir un verdadero sentido de autoría sobre lo que habían escrito.

Aunque el estudio todavía se encuentra en revisión científica, sus resultados coinciden con investigaciones previas sobre los efectos de la externalización cognitiva, es decir, la tendencia a delegar funciones mentales en herramientas tecnológicas.

Fenómenos similares ya habían sido observados con internet y los motores de búsqueda. Diversos estudios detectaron que las personas comenzaron a recordar menos información desde la popularización de Google, un efecto conocido como “efecto Google”, donde el cerebro prioriza recordar dónde encontrar la información en lugar de memorizarla.

Ahora, algunos expertos temen que los LLM profundicen todavía más esta tendencia.

Investigadores de la University of Pennsylvania describieron recientemente un fenómeno llamado “rendición cognitiva”, en el que las personas aceptan las respuestas de la IA con muy poco cuestionamiento, incluso cuando contradicen su propia intuición.

Las preocupaciones no se limitan al ámbito educativo. Un estudio internacional encontró que médicos que utilizaron herramientas de IA para detectar cáncer de colon durante varios meses redujeron posteriormente su capacidad para identificar tumores sin asistencia tecnológica.

La neurocientífica computacional Vivienne Ming, autora del libro Robot Proof, considera que la IA puede ser útil para potenciar el pensamiento humano, pero advierte que el problema aparece cuando se convierte en un reemplazo del esfuerzo mental.

Ming realizó investigaciones con estudiantes de la University of California, Berkeley en las que observó que muchos recurrían directamente a la IA para obtener respuestas sin analizarlas críticamente. Según explica, sus mediciones mostraron una baja activación de ondas gamma cerebrales, asociadas con el esfuerzo cognitivo.

Aunque estos trabajos aún requieren más validación científica, la investigadora teme que un uso excesivamente pasivo de la IA pueda contribuir al deterioro cognitivo a largo plazo.

Algunos estudios previos ya relacionaron una menor actividad cerebral sostenida con procesos asociados al envejecimiento cognitivo y la demencia. Ming recuerda además que la dependencia de herramientas como GPS y sistemas de navegación también ha sido vinculada con el deterioro progresivo de la memoria espacial.

Los especialistas coinciden en que el cerebro necesita desafíos constantes para mantenerse saludable. Resolver problemas, recordar información, argumentar y pensar críticamente forman parte del “ejercicio mental” necesario para preservar las capacidades cognitivas.

Por ello, los investigadores no proponen abandonar la inteligencia artificial, sino aprender a utilizarla de manera más activa y consciente.

Ming sugiere desarrollar una especie de “inteligencia híbrida” entre humanos y máquinas. La idea consiste en pensar primero de manera independiente y utilizar la IA posteriormente para cuestionar, perfeccionar o ampliar las propias ideas, en lugar de aceptar respuestas automáticas.

Una de las estrategias que recomienda es la llamada “instrucción némesis”, donde el usuario pide a la IA que critique sus argumentos y explique por qué podrían estar equivocados. Esto obliga a defender ideas, profundizar el razonamiento y fortalecer el pensamiento crítico.

Otra técnica consiste en pedirle a la IA que no entregue respuestas directas, sino preguntas, contexto y pistas que impulsen a la persona a encontrar soluciones por sí misma.

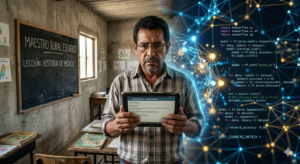

Para Kosmyna, especialmente en la educación, resulta fundamental construir primero bases sólidas de conocimiento antes de depender de herramientas de IA. Solo así, sostiene, estas tecnologías podrán convertirse en apoyos útiles y no en sustitutos del pensamiento humano.

El desafío, concluyen los expertos, no es detener el avance de la inteligencia artificial, sino evitar que la comodidad tecnológica termine debilitando capacidades mentales esenciales como la memoria, la creatividad y el razonamiento profundo.